「社内の情報、どこに何があるか分からない…」

「同じ質問が何度も飛んでくる…」

そんな悩み、感じたことはありませんか?

社内ナレッジの散在や属人化は、DX推進における大きなボトルネック。

しかし今、注目を集めているのが、生成AIを活用したナレッジベースの構築です。

従来の「検索型ナレッジ」ではなく、自然言語で「対話」しながら答えを引き出す仕組み。

本記事では、生成AIナレッジベースの構成・技術・設計・構築・運用までを、図解と実践フローで徹底解説します。

なぜ今、生成AIでナレッジベースなのか?

DX(デジタルトランスフォーメーション)が求められる時代、社内の情報資産、いわゆる「ナレッジ」の活用は業務効率や意思決定の質に直結します。しかし現実には、多くの企業で以下のような課題が顕在化しています。

- 必要な情報が見つからない

- 同じ質問が部署をまたいで繰り返される

- ドキュメントはあるのに誰も読まない

- 情報が個人の頭の中に属人化している

これまでのナレッジベースは、文書を手動で整理し、フォルダ構造やタグで管理し、ユーザーが検索で情報を探す仕組みが中心でした。しかし、これでは「探すコスト」が高く、現場に浸透しづらいのが現状です。

そこに登場したのが生成AIを活用したナレッジベースです。

ChatGPTに代表される大規模言語モデル(LLM)と、関連情報を補完するRAG(Retrieval-AugmentedGeneration)を組み合わせることで、「社内のあらゆる情報に対して、対話的かつ即時に答えを返すAIアシスタント」が実現可能となりました。

例えば次のような使い方が可能になります。

| 従来型ナレッジ検索 | 生成AIナレッジベース |

| 「〇〇についてのマニュアル」と検索→該当ファイルを開いて読む | 「〇〇の設定方法を教えて」と質問→答えを即時に要約・提示 |

| 検索キーワード依存 | 質問内容を文脈で理解 |

| ファイルを探す時間がかかる | 回答がすぐに得られる |

| 人によって検索結果の精度が変わる | 一貫した対応と知識提供が可能 |

このように、生成AIの導入は単なる効率化にとどまらず、ナレッジ活用の“質”そのものを変える大きな転換点となるのです。

次のセクションでは、この仕組みを実現するための技術構成について解説します。

生成AIナレッジベースの基本構成と技術概要

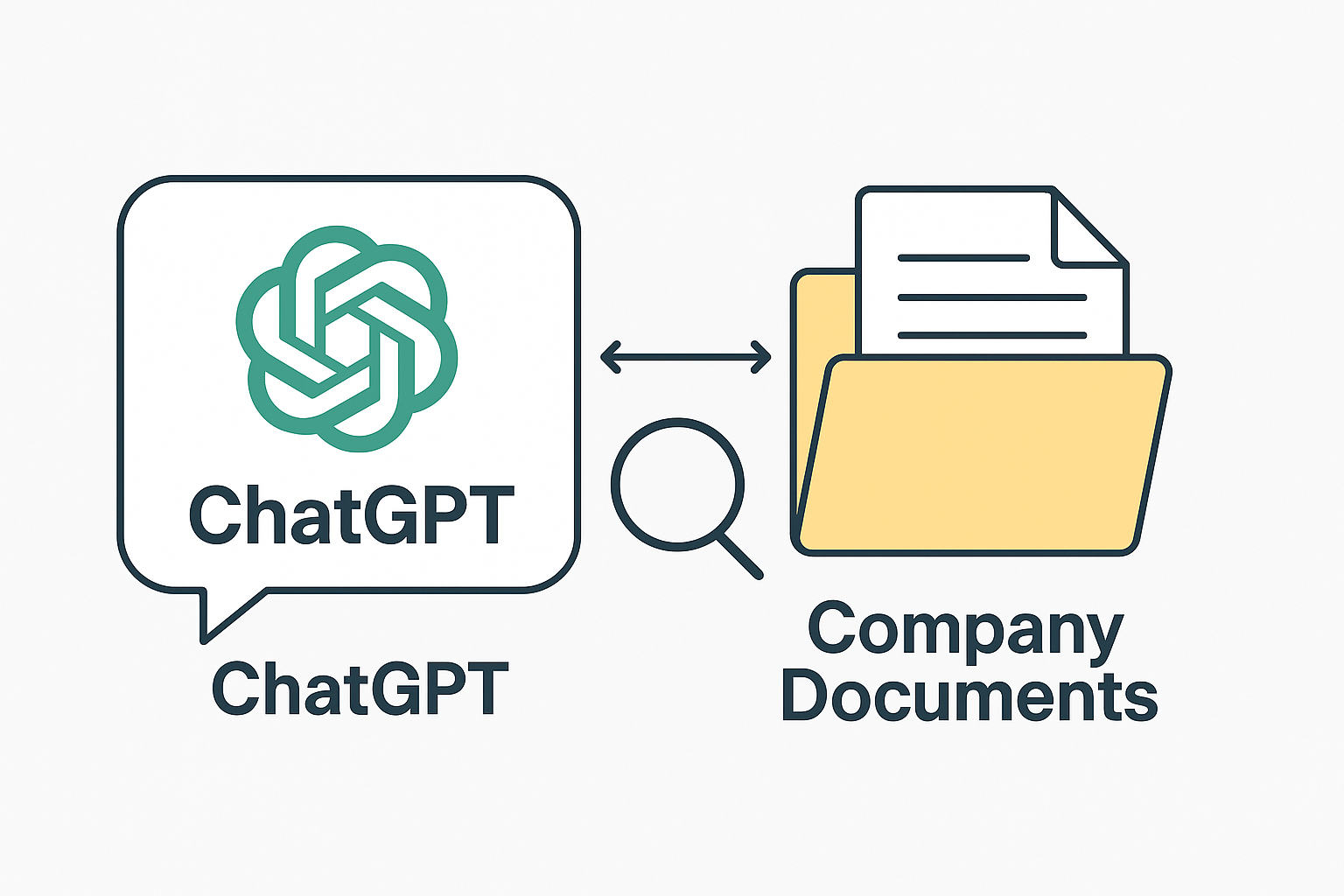

生成AIによるナレッジベースは、一見すると「ChatGPTが社内FAQに答える」ような単純な仕組みに見えるかもしれません。しかし、実際にはいくつかの技術要素が組み合わさるアーキテクチャで構築されます。

ここでは、その基本構成と主要技術を整理しておきましょう。

ナレッジベースの構成要素は大きく4つ

- データソース(ナレッジ)

- 社内のPDFマニュアル、CSV、Word、Excel、Webページ、社内Wikiなど

- これらを一元的に収集・整備するのが出発点

- 社内のPDFマニュアル、CSV、Word、Excel、Webページ、社内Wikiなど

- 前処理・インジェスト

- テキスト化・分割・メタデータ付与などを行い、検索可能な形に整える工程

- テキスト化・分割・メタデータ付与などを行い、検索可能な形に整える工程

- ベクトルデータベース(VectorDB)

- 文書をベクトル(数値)化し、類似性検索を可能にするデータベース

- 例:Pinecone、Weaviate、FAISS、Chromaなど

- 文書をベクトル(数値)化し、類似性検索を可能にするデータベース

- 大規模言語モデル(LLM)+RAG構成

- ChatGPT(OpenAI)やClaude、GoogleGeminiなどと連携し、質問への回答を生成

- RAGにより、事前に検索した社内文書を使って精度の高い回答を作成

- ChatGPT(OpenAI)やClaude、GoogleGeminiなどと連携し、質問への回答を生成

RAGとは何か?

RAG(Retrieval-AugmentedGeneration)は、外部データ(社内ナレッジなど)をAIの回答に取り入れる手法です。

例えば、次のような処理が行われます:

- ユーザーが自然文で質問をする(例:「契約書の保存ルールは?」)

- クエリをベクトル化し、ベクトルDBから関連文書を検索

- 該当文書をLLMに渡して、回答を生成

- 回答と出典をセットで返す

この方式により、「AIが勝手に創作する」のではなく、「企業内に存在する正確な情報をもとに回答する」仕組みが実現します。

実装でよく使われる代表的ツール・技術

| 分類 | ツール・技術名 | 特徴 |

| データ処理 | LangChain/LlamaIndex | データの取り込み・分割・メタ付与・RAG制御などを担うフレームワーク |

| ベクトルDB | Pinecone/Weaviate/Chroma/FAISS | 高速な類似検索に特化。クラウド/オンプレどちらも選べる |

| LLM連携 | OpenAIGPT-4/Claude/Gemini/Mistral | 質問に対して自然な回答を生成する役割 |

| GUI/統合環境 | Microcosm | ローカル・セキュアなナレッジ検索が可能。社内導入に向く国産ツール |

Microcosmとは?

「Microcosm(マイクロコズム)」は、生成AIを活用した社内ナレッジベースを構築できる統合型ツールです。

特徴としては以下の通りです:

- 自社サーバー/オンプレミスでの運用が可能

- ChatGPTとの連携で、自然言語検索による社内FAQ対応が可能

- 権限設定やログ管理など、企業ユースを前提に設計

特にセキュリティ要件が厳しい企業や、クラウドを避けたい現場に適した選択肢として有力です。

ナレッジベース構築の準備フェーズ

生成AIを活用したナレッジベースを構築するには、いきなりAIの導入から始めるのではなく、正確な情報をAIが扱えるようにするための「下準備」が不可欠です。

このフェーズを丁寧に行うかどうかが、構築の成功可否を左右します。

以下に、構築前に押さえておくべき準備ポイントをまとめます。

1.目的とユーザー像の明確化

まず、「誰のために、どんな目的でナレッジベースを作るのか?」を明確にします。

- 想定ユーザー:カスタマーサポート、営業、バックオフィス、人事など

- 想定ユースケース:よくある質問の対応、社内手続きの検索、システムマニュアルの参照など

- 成果指標(KPI例):問い合わせ件数の削減、検索時間の短縮、自己解決率の向上

2.ナレッジソースの棚卸し

どのような情報が社内にあり、どこに存在しているかを一覧化します。

- マニュアル(PDF・Word)

- 手順書・議事録(Excel・テキスト)

- 社内WikiやNotion、Redmineなどのナレッジ共有ツール

- メールやSlack履歴

- データベース(CSV、SQL)

文書の分散や重複、更新の有無もあわせてチェックすることで、AIにとって処理しやすい状態に整えられます。

3.文書の構造整理と統一

AIが正確に理解・検索できるように、文書の構成と命名規則を統一します。

- ファイル名やタイトルは「目的+カテゴリ+日付」などの一貫性を持たせる

- 章立てや見出しを整え、情報の粒度をそろえる

- 無関係な内容(雑記・未確定情報・スキャンPDFなど)は除外または別管理に

4.セキュリティとアクセス権限の設計

ナレッジベースには、社内機密や個人情報が含まれることも多いため、情報の分類とアクセス権の設定が重要です。

- 情報分類:公開/限定公開/秘匿の3レベル程度で分類

- アクセス管理:部署ごと・役職ごとに閲覧制御を設定

- ログ管理:誰が何にアクセスしたかの記録(Microcosmなどで対応可能)

5.運用・更新の責任者を決める

ナレッジベースは「作って終わり」ではなく、「更新され続けること」で価値が生まれます。

- 更新フローの設計:文書の差し替え、最新情報の定期インジェストなど

- 担当者の割り振り:情シス、部門担当、AI運用チームなど

- 現場からのフィードバックを吸い上げるループの設計

この準備フェーズをクリアしてはじめて、生成AIがナレッジベースとして機能する“土台”が整います。

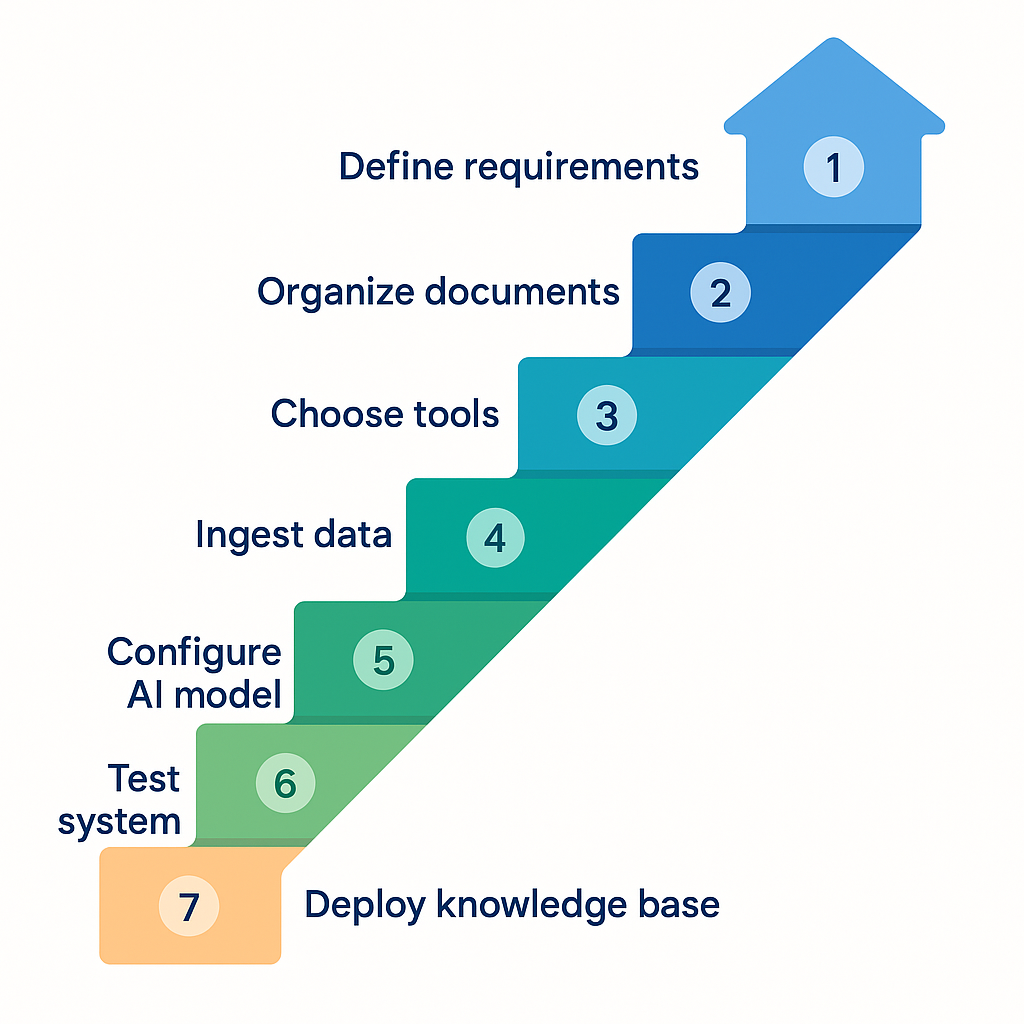

生成AIでナレッジベースを構築する7ステップ

この章では、社内DX推進者が主導で進められる形で、生成AIを活用したナレッジベースの構築手順を7つのフェーズに分けて解説します。

各ステップでは、目的とポイント、代表的なツール例も合わせてご紹介します。

ステップ1:データの収集と整備

まず最初に行うのは、社内に点在しているナレッジの一元収集です。

- 対象:PDFマニュアル、Word手順書、CSV台帳、社内Wiki、Slackログなど

- 目的:ナレッジの可視化と粒度の統一

- ポイント:

- 古いファイルや重複情報は除外

- 自然言語ベースで読みやすい文章を優先

- 古いファイルや重複情報は除外

補足:LlamaIndexやLangChainでは、こうしたデータソースを「インジェスト(取り込み)」するためのコネクターが豊富に用意されています。

ステップ2:インジェストと前処理

次に、収集したデータを生成AIが理解・検索しやすいように整形します。

- 処理内容:

- テキスト化(OCR処理含む)

- セクション単位での分割(チャンク化)

- メタデータの付与(カテゴリ、作成日、作成者など)

- テキスト化(OCR処理含む)

- 使用例:LangChainでチャンクサイズを指定しながら文書分割

- 注意点:チャンクが大きすぎると検索精度が低下、小さすぎると情報が分断される

ステップ3:ベクトル化とDB登録

整形されたテキストを、AIが意味的に検索可能な形に「ベクトル変換」し、専用DBに登録します。

- 使用技術:OpenAIの埋め込みモデル、HuggingFaceのSentenceTransformerなど

- ベクトルDB:Pinecone、Weaviate、Chroma、FAISSなど

- 登録項目:ベクトル、原文、メタデータ

ベクトルDBは、「意味が近い文書」を高速に見つけるための中核的な技術です。

ステップ4:RAG構成でLLMと連携

ベクトル検索によって得られた文書を、大規模言語モデル(LLM)に渡し、回答を生成する構成を設計します。

- 代表モデル:GPT-4、Claude、Geminiなど

- 手法:RAG(検索+生成)によって、文脈に合った高精度な回答を作成

- 実装ツール:LangChainのQAChain、LlamaIndexのQueryEngineなど

このフェーズで、「ただのチャットボット」ではなく**“業務に使えるAI回答者”**が誕生します。

ステップ5:チャットUIや社内ツールとの統合

生成AIの出力を現場で活用するには、UI(ユーザーインターフェース)との統合が必要です。

- チャット形式のインターフェース(例:社内ポータル内のAIアシスタント)

- LINE、Slack、Teamsとの連携

- Notion、Confluence、SharePointなど社内ツールとの統合

Microcosmなどの統合ツールを使えば、UI・検索・管理を一元化した形でのナレッジベース構築も可能です。

ステップ6:テスト・ハルシネーション対策

AIが不正確な回答を生成するリスク(ハルシネーション)に備えるテストフェーズです。

- テスト観点:

- 想定質問と回答の正確性

- 出典付きの根拠表示

- 曖昧な質問に対する返答品質

- 想定質問と回答の正確性

- 対策例:

- 検索対象のスコープを絞る(特定のドキュメント群のみ)

- 回答に出典URLやファイル名を明記

- 管理画面での回答ログ確認と修正フィードバック

- 検索対象のスコープを絞る(特定のドキュメント群のみ)

ステップ7:運用体制とフィードバックループ設計

構築後は、使われ続ける仕組みを整えることが不可欠です。

- 定期的なデータ更新(自動クロール/手動登録)

- フィードバック収集:ユーザーが「参考になった/ならなかった」を評価

- 社内周知と教育:イントラポータルや研修で活用方法を周知

- 管理者向けモニタリング:利用ログや問い合わせ傾向の分析

AIは万能ではありませんが、**現場と連携しながら進化させる“ナレッジ基盤”**として育てる姿勢が重要です。

導入を成功に導くためのポイント

生成AIでナレッジベースを構築すること自体は、技術的な手順を踏めば実現可能です。

しかし、継続的に使われ、組織に定着し、価値を発揮し続けるためには、構築後の運用設計と社内マネジメントが重要です。

このセクションでは、社内DX推進者として意識すべき成功の鍵を4つに絞って解説します。

1.メンテナンス性の確保(情報の更新体制)

ナレッジベースの最大の敵は「情報の陳腐化」です。

AIが最新情報を扱えなければ、誤った回答を導くリスクも生じます。

- 社内文書の更新にあわせたインジェストスケジュールの自動化

- 特定フォルダの監視や、更新履歴との連動

- 担当部門ごとの「ナレッジオーナー」設定で責任を明確に

定期メンテナンスのプロセスが回っていれば、生成AIは常に信頼できる“知識の案内役”であり続けます。

2.ナレッジの分類と粒度の最適化

情報の粒度がバラバラだったり、分類が曖昧だと、AIが適切に回答できません。

- カテゴリやトピック別に情報を分類(例:契約関連/人事手続き/技術マニュアル)

- 「1質問=1答え」が得られるように、情報はできるだけ細分化

- 重複情報は統合し、曖昧表現は具体化することで検索精度が向上

AIの“理解力”を最大限に引き出すためにも、整理された知識体系は不可欠です。

3.セキュリティ・ガバナンスへの配慮

社内の機密情報を扱う以上、セキュリティと透明性は重要な要素です。

- 部門別・役職別でのアクセス制御

- 回答ログの保存と監査可能性(Microcosm等で実装可)

- 機密情報のマスキングや除外処理

- ユーザーへのガイドライン提示(「このAIは参考情報を返す」等の注意文言)

「誰が、何に、どうアクセスしたか」が見える構成であれば、安心して活用できます。

4.社内定着のための教育と周知

どれほど優れたナレッジベースでも、使われなければ意味がありません。

- 活用マニュアルやチュートリアル動画の配信

- 社内ポータルやイントラに検索窓を常設

- チャットボット形式で気軽に触れるUI設計

- 活用事例の共有(「こんな時に役立った」)で社内に展開

社内に“使う文化”が根付けば、自然とフィードバックも増え、ナレッジベースは進化していきます。

導入事例とシミュレーション

生成AIによるナレッジベースの構築は、単なる技術導入にとどまらず、業務そのものの在り方を再定義するきっかけとなりつつあります。

ここでは、業種別の実例とPoC(概念実証)から本格導入に至るプロセスを紹介しながら、その具体的かつ測定可能な成果を明らかにします。

大手企業における導入成果

LINEヤフー「SeekAI」導入:年間70〜80万時間の業務削減を目指す

同社が独自開発した生成AIナレッジベース「SeekAI」は、RAG技術を用いて社内データから最適な回答を生成。

広告事業のカスタマーサポート業務において約98%の正答率を記録し、エンジニアの検索時間も大幅に短縮。

全社展開により、年間70〜80万時間の削減効果を見込んでいます。

三井住友カード:問い合わせ対応時間を最大60%削減へ

月間50万件以上の問い合わせに対し、生成AIによる回答草案生成機能を導入。

2024年6月よりメール対応に適用し、最大60%の業務時間削減を実現する見込みです。

領域別:導入効果の可視化

| 領域 | 企業名 | 改善内容 |

| 知財 | エナジーウィズ | 特許文献の情報抽出作業を自動化。月間120時間超の業務削減を実現。 |

| カスタマーサポート | フランスベッド | チャットボット導入により、対応業務を約30%削減。 |

| 同上 | あしたのチーム | 月間300〜400件の問い合わせを約4分の1に削減。人員体制も8人→2〜3人に圧縮。 |

| 同上 | 白い恋人パーク | FAQ自動回答により、電話問い合わせ件数を前年比14%削減。 |

| 医療 | 医療法人フルーツ | カルテ要約AIにより引き継ぎ時間を70%短縮。情報共有の質も向上。 |

| 製造(GMP) | EQUES | 文書作成業務を最大7割短縮。品質保証業務の負担を大幅軽減。 |

全社業務変革の兆し

情報検索時間の短縮:アサヒビール

R&D部門に生成AI要約ツールを導入。技術文書の理解スピードが向上し、若手社員の業務キャッチアップが迅速化。

属人化の解消:JR東日本

社内文書をもとにしたチャット型検索ツールを全社導入。2024年10月より正式運用予定。ナレッジの共有と標準化が加速。

教育コストの圧縮:ニチバン

過去30年分のカタログをPDF化してナレッジベースに登録。新人対応の工数と検索時間を大幅に短縮。

PoCから本実装へ:成功と課題

成功のカギは「業務成果に直結するKPI設計」

PoCの段階で求められるのは、単なる技術的な精度ではなく、現場の業務改善を数値で示すことです。

例:回答正確率、検索時間削減、誤対応率の低下など。

失敗パターンとその対策

| 課題 | 失敗例 | 解決策 |

| ナレッジ更新が続かない | 初期登録後に運用放置 | 更新フローを明文化。担当者と評価制度を設計 |

| PoCで止まる | 技術試験だけで現場の実感がない | 「小さく成功」できる現場課題に絞ったテーマ設計 |

| 文化が根付かない | 部署ごとに温度差がある | 経営層の支援と、現場主導の評価サイクルを両立 |

業種別の活用パターンと展望

- 製造業:設計・保守のノウハウ検索、過去不具合事例の再利用

- 金融業:法令文書の検索、コンプライアンス業務のサポート

- 営業部門:過去提案資料の要約、トークスクリプトの自動生成

- 自治体・公共:住民対応の効率化、条例・制度説明の自動化

導入効果の実証(研究データより)

MITの研究では、ChatGPTを活用したグループは作業時間を短縮し、成果物の品質も向上したと報告されています。

特に「初期の書き始め時間」を削減できたことが、全体効率の向上に大きく寄与しています。

結論:生成AIナレッジベースがもたらす本質的な変化

- 定量効果:業務時間の削減率は数十%〜70%超、対応件数も半減レベルまで削減可能

- 定性効果:属人化の解消、育成時間の短縮、情報アクセスの民主化

- スケールメリット:全社導入時には年間数十万時間の削減も可能

生成AIの価値は、単なるチャットボットではなく、“組織の知を再活用する”戦略資産の構築にあります。

本実装に向けては、PoC段階から業務成果を重視し、現場と経営をつなぐ設計が必要不可欠です。

加えて、Microcosmのような国産ツールを活用すれば、ナレッジベース構築の最初の4ステップ(データ収集、前処理、ベクトル化、RAG構成)までを自動化・一元管理することが可能です。

技術的な障壁を下げながら、スモールスタートで着実に業務改善を進められる点も、多くの企業にとって導入の後押しとなっています。

まとめ生成AIナレッジベースで社内知の活用を加速

生成AIを活用したナレッジベースの構築は、単なる業務効率化にとどまりません。

それは、組織の「知」を資産として再定義し、全社員が活用できる形に変換する取り組みです。

従来、情報は散在し、アクセスには時間と労力がかかり、属人化も避けられませんでした。

しかし、生成AIの導入により、「聞けばすぐに答えが返ってくる」状態が現実のものとなります。

本記事で紹介した7つのステップを踏めば、DX推進担当者でも実務レベルでナレッジベースを構築できます。

特に以下のような視点が、成功に欠かせません。

- 情報の整理と精度の高い前処理

- 適切な技術(RAG、ベクトルDB、LLM)の選定

- セキュリティや運用ルールの設計

- 社内への浸透と教育体制の整備

Microcosmのような統合ツールを活用すれば、セキュアな環境下でも構築が可能です。

社内の“知”を人に依存させず、システムに蓄積・再活用していくこと。

それは、これからの組織が生き残るための「知的インフラ」とも言えるでしょう。生成AIとナレッジベースの融合は、DXの真の起点となり得ます。

いまこそ、社内ナレッジのアップデートに踏み出すときです。