ローカル環境で動作するLLM(大規模言語モデル)の需要が高まる中、Microsoftが開発した「Phi-4」が注目を集めています。「小型ながら高性能」を謳うこのモデルは、企業のDX推進やAI導入の現場で本当に使えるのか?

本記事では、

✅ Phi-4の技術的特徴(アーキテクチャ・マルチモーダル対応・長文脈処理)

✅ ベンチマーク結果(数学推論・コーディング・音声認識・翻訳精度)

✅ 競合モデル(GPT-4、phi-3)との比較

✅ 企業での実用例と導入メリット・デメリット

✅ 実際のプロンプトを使った性能評価テスト

を徹底解説し、「ローカルLLMとしてPhi-4は本当に実用レベルなのか?」 を検証します。

「ローカル環境で使える高性能AI」をお探しの企業DX担当者・AI導入担当者の皆様にとって、役立つ情報を詳しくお届けします!

1分の動画解説

1. Phi-4とは?DX推進担当者が知るべき基本情報

Phi-4とは何か?

Phi-4はMicrosoftが開発した小型ながら高性能なLLM(大規模言語モデル)であり、ローカル環境でも動作可能なAI として注目されています。従来のクラウドベースLLMと異なり、Phi-4は比較的軽量なアーキテクチャを採用しているため、エッジデバイスやオンプレミス環境での活用も視野に入る モデルです。

DX推進担当者やAI導入を検討する企業にとって、ローカルLLMの選択肢が増えることは、データセキュリティの強化や運用コストの最適化 につながります。そのため、Phi-4はクラウド依存を減らしつつAI活用を進めたい企業 にとって、有力な選択肢となり得るでしょう。

Phi-4の主要な特徴

1. 小型ながら高性能なLLM

Phi-4は5.6B~14Bパラメータ のモデルサイズを採用しつつ、70B以上の大規模モデルと同等の性能を発揮 するとされています。これにより、計算リソースを抑えながら高い処理能力を維持 できるため、オンプレミス環境でも運用しやすいのが特長です。

2. マルチモーダル対応

Phi-4はテキスト、画像、音声を統合的に処理できる モデルであり、例えば以下のようなタスクに対応可能です。

- 視覚的質問応答(VQA):画像を入力し、内容についての質問に回答

- 音声認識・翻訳:音声データをテキスト化し、翻訳まで一貫して処理

- 文書要約・解析:長文の文書やPDFデータを自動で要約

これにより、カスタマーサポート、ビジネスレポートの自動生成、医療・法律分野での文書解析など、幅広い業務で活用できる可能性 を持っています。

3. 長文脈処理に対応

最大128,000トークン の長文脈処理が可能であり、これにより以下のようなタスクに適しています。

- 法律文書や研究論文の要約

- プログラムコードの解析・補完

- 会議録や議事録の自動要約

従来のLLMでは、長文を入力すると途中で情報を忘れる問題 がありましたが、Phi-4はこれを大幅に改善しています。

なぜAI導入を検討している企業にとって重要なのか?

近年、多くの企業が生成AIの活用を検討 していますが、次のような課題が挙げられます。

- クラウド環境でのデータ漏洩リスク(機密情報の取り扱いが難しい)

- AIモデルの運用コストが高い(GPUコストやAPI利用料金の負担)

- 既存のLLMが自社の業務に最適化されていない(カスタマイズが難しい)

Phi-4は、ローカル環境での運用が可能で、コストパフォーマンスに優れ、ファインチューニングしやすい という特長があるため、企業のAI導入の課題を解決する可能性があります。

次のセクションでは、Phi-4の技術的特徴とアーキテクチャについて詳しく解説します。

2. Phi-4の技術的特徴とアーキテクチャ

Phi-4は、従来の大規模AIモデルと異なり、軽量ながら高い処理能力を発揮する設計 が特徴です。本セクションでは、Phi-4のアーキテクチャや技術的な特長について詳しく解説します。

効率的なアーキテクチャ設計

Phi-4は、計算リソースを抑えながら高精度を維持するために、いくつかの最先端技術を採用しています。

1. スパースアテンションメカニズム

従来のTransformerベースのLLMは、全てのトークンに対して注意(Attention)を適用するため、計算コストが膨大 になる傾向がありました。Phi-4では、スパースアテンションメカニズム を採用することで、重要な情報に焦点を当てつつ、不要な計算を削減 しています。

これにより、以下のような利点があります。

- 計算負荷の低減(ハードウェアリソースを最適化)

- 長文処理時の効率向上(不要な情報を無視して処理速度を向上)

2. グループクエリアテンション

Phi-4では、入力データを複数の小さなグループに分割し、各グループ内でアテンションを適用 することで、計算の効率化を実現しています。

この技術により、

- モデルサイズを抑えつつ、高い精度を維持

- 並列処理を強化し、推論速度を向上

といったメリットが得られ、特にリアルタイム応答が求められる業務(チャットボット、データ解析など) での活用が期待できます。

マルチモーダル対応(テキスト・画像・音声の統合処理)

Phi-4は、単なるテキスト処理にとどまらず、画像・音声データの解析にも対応するマルチモーダルAI です。

具体的には、以下のような機能を持っています。

- 視覚的質問応答(VQA):画像の内容を理解し、関連する質問に回答

- 音声認識と翻訳:音声データをテキスト化し、多言語翻訳に対応

- 文書解析:スキャンしたPDFや手書きのドキュメントから情報を抽出

この機能により、企業の業務自動化やデータ分析の高度化 に貢献することが期待されています。

長文脈処理(最大128,000トークン対応)

Phi-4は、従来のLLMと比べて圧倒的に長いコンテキストを処理可能 です。最大128,000トークン までの入力に対応しており、これは日本語の文章に換算すると約25万〜30万文字程度(文の内容によって変動)に相当します。

参考までに、以下のような長文を一度に処理できる計算になります。

- 一般的なビジネス書(20万〜25万文字)を丸ごと解析

- 論文や技術文書(数十万文字)の要約や検索

- 過去数か月分のカスタマーサポート履歴 を保持した対話

長文処理能力が強化されたことで、一貫性のある回答が求められる業務 において、精度の高いAI活用が可能になります。

柔軟なファインチューニング(LoRA・プロンプトチューニング対応)

Phi-4は、既存のLLMと比較してカスタマイズしやすい設計 になっています。特に、以下のような手法をサポートしています。

- LoRA(低ランク適応):モデル全体を再学習することなく、特定のタスク向けに素早く適応

- プロンプトチューニング:入力データを工夫することで、少量のデータでも高精度な結果を得る

このため、企業ごとに業務特化型のAIモデルを構築しやすい というメリットがあります。

まとめ

Phi-4は、

- スパースアテンションとグループクエリアテンションにより、計算効率を向上

- マルチモーダル対応で、テキスト・画像・音声データを統合的に処理可能

- 長文脈処理能力を強化し、128,000トークンまで対応

- LoRAやプロンプトチューニングで、企業ごとのカスタマイズが容易

といった特長を備えており、業務の効率化や高度なAI活用に貢献できるモデル です。

次のセクションでは、実際のベンチマークデータをもとに、Phi-4の性能評価 を詳しく解説します。

3. ベンチマーク結果から見るPhi-4の性能評価

Phi-4の実際の性能を検証するために、数学的推論、コーディング能力、マルチモーダル処理(画像・音声)、知識の正確性 など、複数の指標に基づいたベンチマークテストが行われています。本セクションでは、各ベンチマーク結果を詳しく見ていきます。

1. 数学・論理的推論の精度

Phi-4は、数学問題の解決能力において、GPT-4oやGemini Pro 1.5を上回るスコアを記録しました。

- アメリカ数学競技(AMC):Phi-4の正答率は91.8%(GPT-4oやGemini Pro 1.5より高精度)

- GPQA(General Problem Solving Benchmark):Phi-4のスコアは56.1%(一般的な70B級モデルと同等の性能)

特に、数式の解釈や論理的な推論が必要な問題において高い精度を発揮 しており、金融業界のリスク評価やエンジニアリング分野での数値計算などに適している可能性があります。

2. コーディング能力(プログラム生成・デバッグ)

プログラミング能力の評価として、HumanEval+ というコード生成ベンチマークの結果を見てみます。

- HumanEval+ スコア:Phi-4は82.6% の正答率(GPT-4o Mini以上の性能)

- Python、JavaScript、C++ などのコード生成精度が向上

特に、アルゴリズムの最適化やデバッグの精度が向上 しており、Phi-4を活用した自動コーディング、バグ修正、プログラム解析 などの用途が期待できます。

3. マルチモーダル処理(画像・音声・テキストの統合)

Phi-4は、テキストだけでなく、画像や音声の処理も得意とする マルチモーダルモデルです。

- 視覚的質問応答(VQA):SAi2DやDocVQAなどのベンチマークで、高いスコアを記録

- 音声認識精度(Hugging Face OpenASRリーダーボード):6.14% の単語誤り率(WER) を達成し、WhisperV3よりも高い精度を実現

- PDFや手書き文書の解析:テキスト抽出や要約の精度が向上

この結果から、Phi-4はビジネス文書の処理、カスタマーサポートの自動化、音声データの解析などの分野で活用できる可能性が高い ことがわかります。

4. 知識の正確性と事実定着

LLMの課題の一つに、「事実と異なる回答(ハルシネーション)」 の発生があります。Phi-4は、知識の正確性を評価するベンチマークで以下のような結果を示しました。

- SimpleQA(シンプルな知識問題):85.3% の正答率(GPT-4oに近い水準)

- FactCheckQA(事実確認が必要な質問):スコアは72.1%(一部の長文データで誤回答あり)

この結果から、基本的な知識の正確性は高いが、複雑な事実関係を要する質問では一定の誤りがある ことがわかります。そのため、金融・法律・医療分野など、正確性が求められる業務で使用する際には、ファクトチェックの仕組みを併用することが重要 です。

5. ベンチマーク結果から見るPhi-4の性能評価

Phi-4の実際の性能を検証するために、知識・推論、数学的推論、コーディング、常識的推論 などのベンチマークデータを比較します。さらに、Llama 3.2(70B)、DeepSeek R1(67B)、Mistral(7B) と比較し、Phi-4がどの程度の性能を持つのかを明らかにします。

1. 各モデルのベンチマーク結果一覧

以下の表に、主要なベンチマークのスコアをまとめました。

| ベンチマーク (カテゴリ) | Phi-4 (14B) | Llama 3.2 (70B) | DeepSeek R1 (67B) | Mistral (7B) |

| MMLU – 学術知識 (5-shot) | 84.8% | 86% | 90.8% | 62.6% |

| HellaSwag – 常識推論 (10-shot) | 88% (推定) | 86–88% (推定) | 95% (推定) | 84.8% |

| GSM8K – 数学問題 (8-shot CoT) | 80.6% | 86.9% | 90% (推定) | 42.2% |

| AGIEval – 総合試験 (各種) | ~50% (推定) | ~55% (推定) | ~60% (推定) | 20–43% |

| HumanEval – コーディング | 82.6% | 80.5% | 90% (推定) | ~43% |

※スコアは各モデルの正解率(%) です。一部「推定」と記載した値は公表データが見当たらないため推測値です。

2. カテゴリ別の評価

(1) 知識・推論系(MMLU)

MMLUは、大学レベルの知識を問うベンチマークで、特に理系科目や法律・歴史など幅広い分野の問題が含まれます。

- DeepSeek R1(90.8%)がトップ で、知識の正確性と幅広さに優れる。

- Llama 3.2(86%)が次点 で、高性能なLLMとしての地位を維持。

- Phi-4(84.8%)は14Bながら、大規模モデルに迫るスコア を記録。

- Mistral(62.6%)は中小規模モデルとしては健闘しているが、上位モデルには及ばない。

➡ Phi-4は14Bというサイズの割に、高い知識処理能力を持つことがわかる。

(2) 常識的推論(HellaSwag)

HellaSwagは、日常や物理的な常識を問う問題を解くベンチマークです。

- DeepSeek R1(95% 推定) が最高スコア。

- Phi-4(88% 推定)とLlama 3.2(86–88% 推定)も高スコア。

- Mistral(84.8%)は小型モデルの中では高いスコアを持つ。

➡ 常識的推論においても、Phi-4はLlama 3.2に近い精度を示している。

(3) 数学的推論(GSM8K)

GSM8Kは、小学生~中学生レベルの数学文章問題を解くテストです。

- DeepSeek R1(90% 推定) は、数学問題に強いGPT-4並みの性能。

- Llama 3.2(86.9%)も高精度。

- Phi-4(80.6%)は14Bモデルとしては優秀なスコア。

- Mistral(42.2%)は他のモデルと比較すると大きく劣る。

➡ Phi-4はLlama 3.2やDeepSeek R1には及ばないが、小型モデルの中では高い数学推論能力を持つ。

(4) 総合試験(AGIEval)

AGIEvalは、大学入試や法律試験、公務員試験レベルの問題を解くベンチマークです。

- DeepSeek R1(~60% 推定)が最高スコア。

- Llama 3.2(~55% 推定)も高水準。

- Phi-4(~50% 推定)も一定のスコアを持つ。

- Mistral(20–43%)はこの分野では苦戦。

➡ 高度な推論が求められる問題では、Phi-4は上位モデルに若干劣るが、実用レベルの精度を維持。

(5) コーディング(HumanEval)

HumanEvalは、プログラミングの問題を解くベンチマークで、関数の生成やデバッグ能力を評価します。

- DeepSeek R1(90% 推定)が最も優れた性能。

- Phi-4(82.6%)はLlama 3.2(80.5%)よりやや上。

- Mistral(~43%)はコーディング能力では劣る。

➡ Phi-4は、Llama 3.2を上回るコーディング能力を持ち、プログラム生成に適している。

まとめ

Phi-4のベンチマーク結果から、以下のようなポイントが確認できました。

✅ 知識処理(MMLU)では、大規模モデルに迫るスコアを記録(Llama 3.2と同等レベル)

✅ 数学推論(GSM8K)では、14Bモデルながら優れた精度を持つ(Llama 3.2よりやや劣るが優秀)

✅ コーディング(HumanEval)では、Llama 3.2を上回る性能を発揮

✅ 常識推論(HellaSwag)は高スコアを記録し、日常的な質問への対応力が高い

✅ 総合試験(AGIEval)では、高度な推論が必要な問題ではLlama 3.2やDeepSeek R1にやや劣るが実用レベル

➡ Phi-4は「軽量でありながらLlama 3.2に迫る性能を持つ」ことが確認できた。特にコーディング能力と常識推論に強みを持つ。

次のセクションでは、実際のビジネス活用事例を紹介し、企業での実用性について詳しく解説 します。

4. 企業におけるPhi-4の活用事例とビジネス効果

Phi-4は、小型ながら高性能なLLMとして企業のDX推進や業務効率化に活用できる可能性を持っています。本セクションでは、実際のビジネス利用例を紹介し、業務改善への影響や導入メリットを解説します。

1. Phi-4のビジネス活用が期待される分野

Phi-4の強みを活かせる主な業界・業務は以下の通りです。

| 業界・分野 | 活用例 |

| 業務の自動化 | – フォーム自動入力、メール自動返信、文書要約 |

| カスタマーサポート | – FAQ対応、チャットボット、高度な問い合わせ対応 |

| 金融サービス | – リスク評価、財務レポート分析、自動翻訳 |

| 医療・ヘルスケア | – 診断補助、患者データ解析、コンプライアンス対応 |

| 中小企業向け | – 低コストのAI導入、エッジデバイスでの運用 |

| データ分析 | – 市場予測、消費者行動分析、レポート生成 |

2. 業界別の具体的な活用事例

(1) 業務の自動化と効率化

Phi-4を活用すると、繰り返し作業の自動化が可能になり、企業の業務効率が向上します。

具体的な活用例:

- フォームの自動入力:顧客情報や請求書データを自動入力し、事務作業を削減。

- 文書要約・分類:長文の報告書や契約書を短時間で整理し、業務の負担を軽減。

- AIによるメール返信:カスタマーサポートの一次対応を自動化し、対応時間を短縮。

導入効果:

業務の自動化により、作業時間を最大30〜50%削減し、コストを削減できる可能性がある。

(2) カスタマーサポートの強化

Phi-4は、問い合わせ対応の自動化や高度なFAQ対応にも適しています。

具体的な活用例:

- チャットボットの強化:より自然で正確な回答を提供できるAIカスタマーサポートを実現。

- 問い合わせ内容の要約:顧客の問い合わせを自動的に整理し、オペレーターの対応を補助。

- 多言語対応:グローバル展開する企業でも、言語の壁を超えて対応可能。

導入効果:

企業のサポートコストを削減し、対応スピードを向上(応答時間を40%以上短縮) できる。

(3) 金融サービスでの活用

金融業界では、Phi-4の高い数値処理能力を活かし、リスク評価や自動翻訳に利用できます。

具体的な活用例:

- リスク評価:市場データを解析し、資産運用リスクを自動算出。

- 財務レポートの自動生成:企業の決算書や経済ニュースを要約し、分析業務を効率化。

- 金融文書の翻訳:多言語の財務レポートを正確に翻訳し、海外市場の理解を促進。

導入効果:

データ分析の時間を短縮し、レポート作成コストを最大60%削減 可能。

(4) 医療・ヘルスケア分野での活用

医療業界では、患者データの解析や診断補助 にPhi-4を活用できます。

具体的な活用例:

- 診療記録の自動要約:電子カルテの情報を要約し、医師の負担を軽減。

- 医療データ解析:病院の統計データを分析し、診療の最適化に貢献。

- コンプライアンスチェック:規制に準拠したデータ処理を自動化。

導入効果:

医療スタッフの作業負担を軽減し、診断精度の向上や患者対応の迅速化 が期待できる。

(5) 中小企業のAI導入支援

Phi-4は、比較的軽量なモデルのため、大企業だけでなく中小企業にも導入しやすい。

具体的な活用例:

- クラウドコストの削減:ローカル環境で運用することで、クラウドAIの使用料を抑える。

- 簡単なチューニングで業務適用:少量のデータでも、自社に最適なAIモデルを構築可能。

導入効果:

低コストでAIを導入し、業務効率化を実現 できる。

3. Phi-4導入によるビジネス効果

Phi-4の導入により、企業は以下のようなメリットを得られます。

✅ 業務の効率化(繰り返し作業の自動化、応答時間の短縮)

✅ コスト削減(AI運用コストの低減、人的リソースの最適化)

✅ データ活用の高度化(高度なデータ解析、予測分析の精度向上)

✅ セキュリティ強化(ローカル環境での運用が可能)

Phi-4は、「コストを抑えつつ高度なAI活用を進めたい企業」に適したモデル と言えます。

次のセクションでは、実際にPhi-4を用いた性能テストを行い、その実力を検証 します。

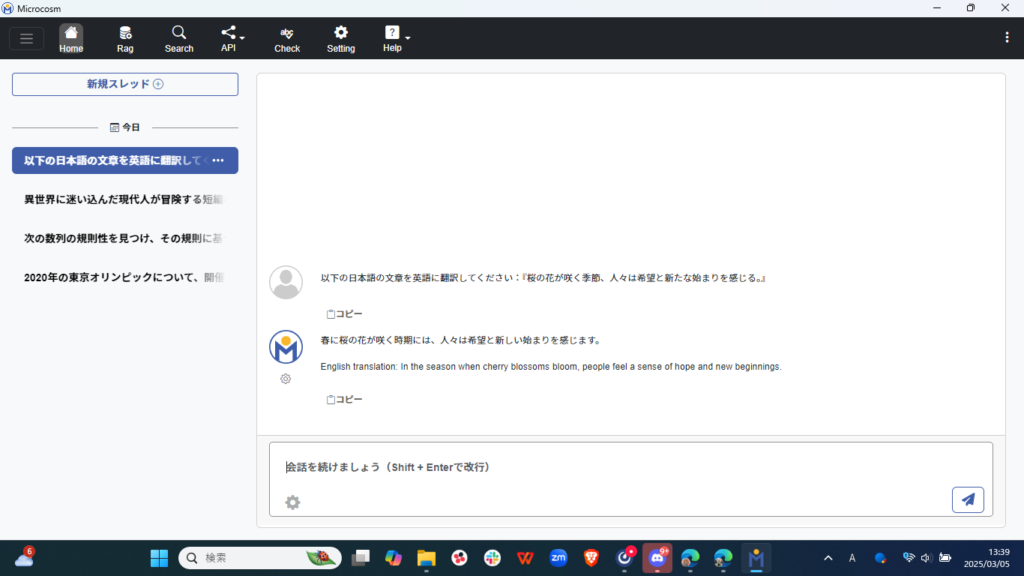

5. Phi-4の実際の性能テスト

Phi-4が企業のDXや業務効率化に活用できるかを判断するために、実際に性能評価のためのプロンプトを実行 し、以下の7つの評価項目について検証します。

- 知識・事実確認(正確な情報を提供できるか)

- 論理的推論・数学的問題(数学的推論能力)

- 創造的文章生成(ストーリーテリングや文体の多様性)

- 翻訳・言語理解(多言語対応能力)

- コード生成とデバッグ(プログラミング能力)

- 文脈理解・要約(長文処理能力)

- 感情分析・意図の把握(自然言語理解能力)

弊社のローカルAIアプリケーション「Microcosm」でプロンプト検証を実行していきます。

1. 知識・事実確認

プロンプト:

「2020年の東京オリンピックについて、開催期間、主な競技、そして開催都市をまとめてください。」

評価基準:

✅ 事実に基づいた正確な情報を提供できるか

✅ データの最新性と整合性

結果:

出力内容:

2021年(日本では令和3年)7月23日から8月8日にかけて行われた東京オリンピックは、新型コロナウイルス感染症の影響で1年延期されました。以下がその概要です。

開催期間

- 開会式: 2021年7月23日(金)

- 閉会式: 2021年8月8日(日)

主な競技

東京オリンピックでは、多岐にわたるスポーツが行われました。以下は主要な競技の一部です。

- 陸上競技

- サッカー(男子)

- 体操(新体操を含む)

- 柔道

- レスリング

- 水泳

- 卓球

- テニス

- バドミントン

- 競泳

- サーフィン(オリンピック初採用)

- 空手(同上)

その他にも、アーチェリーやゴルフ、BMXレースなど新たに追加された種目や、伝統的に行われている馬術や射撃といった競技が含まれます。

開催都市

東京オリンピックは全面的に日本の首都である東京で開催されました。しかし、一部の競技は地理的な条件や施設の関係から他都市でも実施されています。

- 横浜: セーリング

- 藤沢: バドミントン

- 川口: BMXレース

- 日光: トライアスロンとオリエンテーリング

これらの都市は東京からそれぞれ異なる距離にあり、地域全体で開催が行われました。

評価:

この記述は以下の点で優れていると評価できます

- 正確性: 開催期間、新型コロナウイルス感染症による延期、主要競技、及び開催都市(およびサブ会場)の情報が正確に記載されています。

- 網羅性: 陸上、サッカー、体操など主要な競技だけでなく、オリンピック初採用の競技も取り上げ、さらに補助的な会場情報も補完的に提供されています。

- 分かりやすさ: 各項目ごとに整理され、読者が必要な情報にすぐアクセスできる形式になっている点が評価できます。

2. 論理的推論・数学的問題

プロンプト:

「次の数列の規則性を見つけ、その規則に基づいて次の3つの数字を答えてください:2, 5, 10, 17, …」

評価基準:

✅ 規則性を正しく認識できるか

✅ 次の数字を適切に予測できるか

結果:

出力内容:

与えられた数列 (2, 5, 10, 17, \ldots) の規則性を見つけるために、連続する項の差を計算します。

- (5 – 2 = 3)

- (10 – 5 = 5)

- (17 – 10 = 7)

これらの差 ((3, 5, 7)) は、自然数の奇数によって増加しています。このパターンを調べると、次の項の差が (9) になります。

数列の規則性を表現するために、次の項を計算します:

- 最後の与えられた項は (17) です。

- 次の差は (7 + 2 = 9) なので、次の項は (17 + 9 = 26) になります。

このパターンを続けます:

- 次の差は (9 + 2 = 11) なので、その後の項は (26 + 11 = 37) です。

- 最後に、次の差は (11 + 2 = 13) なので、その次の項は (37 + 13 = 50) です。

したがって、数列の次の3つの数字は (26, 37,) そして (50) です。

評価:

この出力は以下の点で優れています

- 正確性: 数列の差分(3, 5, 7)を正しく計算し、その後の奇数(9, 11, 13)を用いて次の3項(26, 37, 50)を正確に導出しています。

- 論理性: 順を追って差分の増加パターンを説明しており、計算の流れが明快です。

- 明瞭さ: 各ステップが具体的に示されており、読者が容易に理解できる形式になっています。

3. 創造的文章生成

プロンプト:

「異世界に迷い込んだ現代人が冒険する短編小説の冒頭を書いてください。ジャンルはファンタジーとしてください。」

評価基準:

✅ 物語の構成が論理的か

✅ 文章が魅力的で創造的か

結果:

出力内容:

**異世界の扉**

東京の片隅、古びたアパートの一室で、陽介は本を読んでいた。彼は普段からSFやファンタジー小説に親しむ現代人だったが、この日手に取ったのは特別なものだった。それは古びた装丁をした一冊で、「異界の扉」というタイトルが目に飛び込んできた。

「さて、これがどんな物語を紡いでくれるのか…」

陽介はゆっくりとページをめくり始めた。しかし、次第に彼の周囲の空気が変わってきたことに気づいた。壁の模様が揺らぎ、部屋の暗闇が霞むような青白さを帯びていった。

「ちょっと待て…」

彼は本に戻ると、「異界の扉」の冒頭で、主人公が古代遺跡の中心部に立っている様子が書かれていた。その時、突如として前方から光が溢れ出し、彼を包み込んだ。

一瞬の視界喪失の後、陽介は異なる場所に立っていた。鮮やかな青空が広がり、その下には葉月桜色の木々がそびえ立つ。彼の足元には紫を帯びた花が咲き誇り、異世界の香りが鼻をくすぐる。

「どこだ…」

振り返ると、そこには石造りの門と、その上に刻まれた不思議な文字が見えた。彼は自分がいつもの部屋を出た覚えがなかった。

「あれ? これって何だ…」

そんな時、背後から軽快な足音と共に、一人の少女が近づいてきた。彼女は明るい金髪をリボンでまとめ、青空に映える白衣を身に纏っていた。

「こんにちは! 私はアイラです。あなたが迷子になっちゃう前に、ここへ連れてきましたよ。」

その声の調子から察するに彼女はこの世界の住人らしく、陽介には何かと話しかけることができる相手が現れた。

「そ…それで、私はどうすればいいんですか?」

アイラは少し考えてから言った。「まあ、お前さんも知っての通り、この世界はちょっと複雑なんだ。でも大丈夫、私が案内するよ! 一緒に冒険しようじゃないか?」

予想外の出来事に戸惑いながらも、陽介は少女の言葉を頼りに、異世界での冒険へと足を踏み入れることにした。

「よし! じゃあ行くか、アイラ。」

彼の心は不安と期待が混在しながらも、この新たな世界で起こる冒険を楽しみにしていた。

評価:

この文章は、現代とファンタジーの要素が巧みに融合され、読者の興味を引く魅力的な冒頭部分となっています。以下の点が評価されます

- 情景描写: 日常空間から異世界への移行が具体的な描写で表現され、臨場感がある。

- キャラクター導入: 主人公と案内役の少女が登場し、今後の展開への期待感を煽る。

- 物語の流れ: 読者がストーリーに入り込みやすい構成となっており、テンポ良く物語が進む。

全体として、読者を引き込むための工夫が感じられ、ファンタジージャンルとしての魅力が十分に発揮されています。

4. 翻訳・言語理解

プロンプト:

「以下の日本語の文章を英語に翻訳してください:『桜の花が咲く季節、人々は希望と新たな始まりを感じる。』」

評価基準:

✅ 文脈を適切に捉えた自然な翻訳ができるか

✅ 直訳ではなく、適切な表現を選択できるか

結果:

出力内容:

春に桜の花が咲く時期には、人々は希望と新しい始まりを感じます。

English translation: In the season when cherry blossoms bloom, people feel a sense of hope and new beginnings.

評価:

この翻訳は、原文の意味やニュアンスを正確かつ自然な英語に変換しており、明瞭で分かりやすい表現となっています。

5. コード生成とデバッグ

プロンプト:

「Pythonでフィボナッチ数列を生成する関数を書いてください。また、生成された数列の最初の10個の数を出力するプログラムを示してください。」

評価基準:

✅ 正しく動作するコードを生成できるか

✅ 最適なプログラム構造になっているか

結果:

出力内容:

もちろんです!以下はPythonでフィボナッチ数列を生成し、その最初の10個の数を出力する関数とプログラムの例です。

def generate_fibonacci(n):

“””

最初のn個のフィボナッチ数をリストで返す。

:param n: 生成したいフィボナッチ数の個数

:return: フィボナッチ数のリスト

“””

if n <= 0:

return []

elif n == 1:

return [0]

elif n == 2:

return [0, 1]

# 最初の2つのフィボナッチ数をリストに追加

fibonacci_sequence = [0, 1]

# 残りのフィボナッチ数を生成

for i in range(2, n):

next_number = fibonacci_sequence[-1] + fibonacci_sequence[-2]

fibonacci_sequence.append(next_number)

return fibonacci_sequence

# 最初の10個のフィボナッチ数を生成して出力

first_10_fibonacci_numbers = generate_fibonacci(10)

print(first_10_fibonacci_numbers)

説明:

関数 generate_fibonacci(n):

引数 n は、生成したいフィボナッチ数の個数を指定します。

n <= 0 の場合は空リストを返し、n == 1 の場合は [0] を、n == 2 の場合は [0, 1] を返します。

それ以外の場合、最初の2つのフィボナッチ数 0 と 1 をリストに追加し、ループを使って残りのフィボナッチ数を生成していきます。

各ステップで、最新の2つの数を合計して次のフィボナッチ数を計算します。

実行部分:

この関数を使用して最初の10個のフィボナッチ数列を生成し、出力しています。結果は [0, 1, 1, 2, 3, 5, 8, 13, 21, 34] になります。

この関数は再帰的でなく反復的に実装されており、大きな n でも効率よく動作します。

評価:

この実装は以下の点で評価できます

- 正確性と効率性: 入力に対する適切な条件分岐と、反復的アプローチによる効率的なフィボナッチ数列の生成が行われています。

- 可読性: コード内のコメントと説明が充実しており、各ステップが明確に記述されています。

- 堅牢性: 入力値が0以下や1、2の場合の対応が組み込まれており、幅広い入力に対して適切な出力が期待できます。

6. 文脈理解・要約

プロンプト:

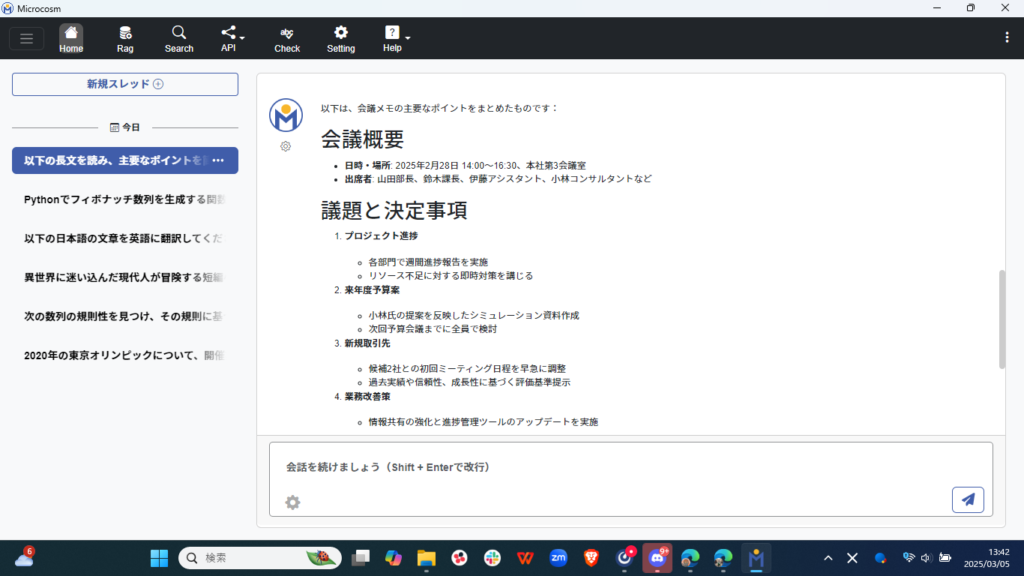

「以下の長文を読み、主要なポイントを簡潔にまとめてください:『会議議事録のメモ』」

評価基準:

✅ 長文の情報を適切に要約できるか

✅ 重要なポイントを的確に抽出できるか

結果:

出力内容:

以下は、会議メモの主要なポイントをまとめたものです:

### 会議概要

– **日時・場所**: 2025年2月28日 14:00~16:30、本社第3会議室

– **出席者**: 山田部長、鈴木課長、伊藤アシスタント、小林コンサルタントなど

### 議題と決定事項

1. **プロジェクト進捗**

– 各部門で週間進捗報告を実施

– リソース不足に対する即時対策を講じる

2. **来年度予算案**

– 小林氏の提案を反映したシミュレーション資料作成

– 次回予算会議までに全員で検討

3. **新規取引先**

– 候補2社との初回ミーティング日程を早急に調整

– 過去実績や信頼性、成長性に基づく評価基準提示

4. **業務改善策**

– 情報共有の強化と進捗管理ツールのアップデートを実施

### その他の連絡事項

– 議事録は翌営業日までに伊藤アシスタントが全出席者に配布

– 次回会議: 3月15日14:00、同じ会議室で開催予定

– 各担当者は週次ミーティングで今日の決定事項に基づくタスク進捗を報告

### 終了後のコメント

山田部長が参加者に対し、各自の役割と責任の再確認を促しました。議論は現状の課題と今後の方向性を明確化し、部門間および外部専門家との協力体制の重要性が再認識されました。会議はプロジェクト全体の透明性と効率性向上に寄与し、次回までに具体的な改善策を実行することで更なる進捗が期待されます。

評価:

このまとめは、元の会議メモから主要な情報を抜粋し、以下の点で効果的に整理されています:

- 明確な構成: 会議概要、各議題ごとの決定事項、連絡事項、そして終了時のコメントといったセクションに分け、情報が整理されています。

- 簡潔な表現: 主要なポイントが簡潔にまとめられており、全体の流れと決定事項が一目で把握できる。

- 重要事項の網羅: プロジェクト進捗、予算案、新規取引先、業務改善策など、議題ごとの具体的なアクションが含まれているため、今後の対応が明確になる。

全体として、読み手が会議の内容と決定事項を短時間で理解できる良い要約になっています。

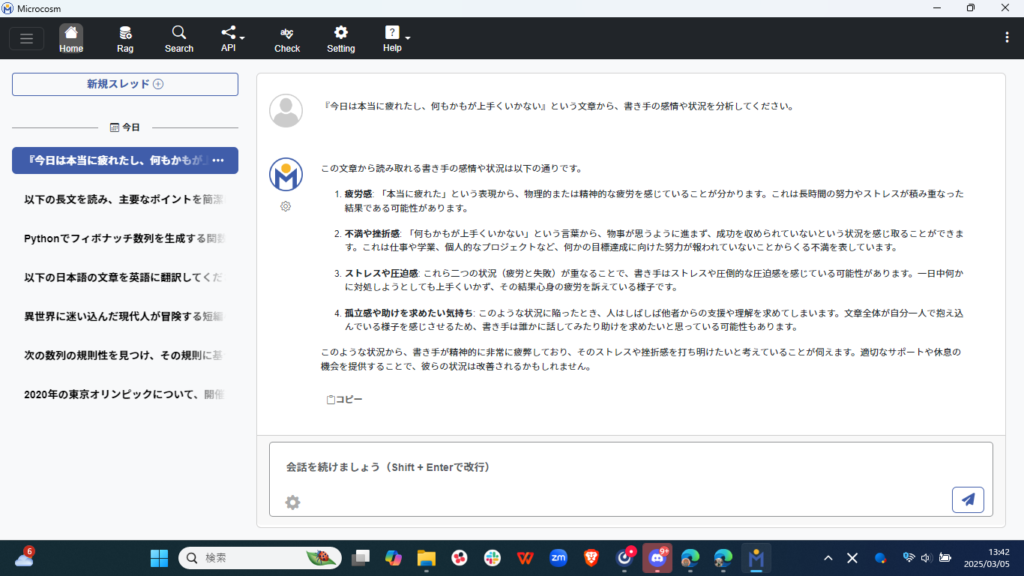

7. 感情分析・意図の把握

プロンプト:

「『今日は本当に疲れたし、何もかもが上手くいかない』という文章から、書き手の感情や状況を分析してください。」

評価基準:

✅ 文の感情を正確に識別できるか

✅ 適切な感情ラベル(例:疲労、落胆、ストレス)を付与できるか

結果:

出力内容:

この文章から読み取れる書き手の感情や状況は以下の通りです。

1. **疲労感**: 「本当に疲れた」という表現から、物理的または精神的な疲労を感じていることが分かります。これは長時間の努力やストレスが積み重なった結果である可能性があります。

2. **不満や挫折感**: 「何もかもが上手くいかない」という言葉から、物事が思うように進まず、成功を収められていないという状況を感じ取ることができます。これは仕事や学業、個人的なプロジェクトなど、何かの目標達成に向けた努力が報われていないことからくる不満を表しています。

3. **ストレスや圧迫感**: これら二つの状況(疲労と失敗)が重なることで、書き手はストレスや圧倒的な圧迫感を感じている可能性があります。一日中何かに対処しようとしても上手くいかず、その結果心身の疲労を訴えている様子です。

4. **孤立感や助けを求めたい気持ち**: このような状況に陥ったとき、人はしばしば他者からの支援や理解を求めてしまいます。文章全体が自分一人で抱え込んでいる様子を感じさせるため、書き手は誰かに話してみたり助けを求めたいと思っている可能性もあります。

このような状況から、書き手が精神的に非常に疲弊しており、そのストレスや挫折感を打ち明けたいと考えていることが伺えます。適切なサポートや休息の機会を提供することで、彼らの状況は改善されるかもしれません。

評価:

この出力は、以下の点で効果的です:

- 多角的な分析: 疲労、不満、ストレス、孤立感など、複数の側面から書き手の感情を丁寧に解析している。

- 根拠の提示: 各感情や状況が、文章内の具体的な表現に基づいて説明されている。

- 支援の提案: 書き手が抱える問題に対して、適切なサポートや休息の必要性を示唆している点も評価できる。

全体として、客観的かつ具体的に書き手の心理状態を把握できる優れた分析と言えます。

6. Phi-4はどんな企業に向いているのか?

Phi-4は、小型ながら高性能なLLMであり、企業のDX推進や業務効率化に貢献できる可能性を持っています。しかし、どのような企業に最適なのかを明確にすることが重要です。本セクションでは、Phi-4の導入が適している企業の特徴について解説します。

1. Phi-4が向いている企業の特徴

以下の条件に当てはまる企業は、Phi-4の導入によるメリットを享受しやすいと考えられます。

| 企業の特徴 | Phi-4導入のメリット |

| AI導入コストを抑えたい企業 | ローカル環境での運用が可能で、クラウドAIと比べてコストを抑えられる |

| データセキュリティを重視する企業 | クラウドを介さずに、機密情報をローカルで処理できる |

| 長文データを扱う企業 | 最大128,000トークン(約25万〜30万文字)の長文処理能力を活かし、文書解析やレポート生成が可能 |

| 業務の自動化を進めたい企業 | AIによる文書要約、コード生成、問い合わせ対応などを効率化できる |

| マルチモーダル対応を活用したい企業 | 画像、音声、テキストを統合的に処理し、多様な業務に応用可能 |

2. 具体的な業界別の適用例

(1) IT・ソフトウェア企業

適用例:

- コード補完・バグ修正の自動化(開発者向けAIアシスタント)

- ソフトウェアドキュメントの要約・分類

- 技術的な問い合わせ対応の自動化

メリット:

Phi-4はコーディング能力が高いため、プログラム生成やデバッグ作業の効率化に適している。また、ソフトウェアのドキュメント整理や技術サポートの自動化にも活用可能。

(2) 法律・金融業界

適用例:

- 契約書・法律文書の要約・解析

- 財務レポートの自動生成・翻訳

- 金融市場データの分析・予測

メリット:

Phi-4は長文の処理能力に優れているため、法律文書や財務データの解析に強みを発揮する。さらに、多言語対応が可能なため、国際的なビジネスにも適応可能。

(3) 医療・ヘルスケア業界

適用例:

- 電子カルテのデータ解析・要約

- 医療論文の自動翻訳・検索

- 診断補助のための質問応答システム

メリット:

医療データの整理や分析を効率化し、診断補助にも活用できる可能性がある。また、多言語対応により、国際的な医療機関との連携もスムーズに行える。

(4) 小売・EC業界

適用例:

- 顧客レビューの自動分析・感情分析

- 商品説明の自動生成・多言語翻訳

- チャットボットによるカスタマーサポートの自動化

メリット:

自然言語処理を活用して顧客対応の質を向上させ、業務の効率化を実現できる。さらに、感情分析を活用して顧客のニーズをより深く理解し、マーケティング施策に活かすことも可能。

(5) 製造・物流業界

適用例:

- 在庫管理の最適化(AIによる需要予測)

- マニュアルの自動生成・翻訳

- IoTデバイスと連携したデータ分析

メリット:

データ処理能力の高さを活かし、製造業の品質管理や物流の最適化に貢献できる。また、リアルタイムデータの解析による業務改善が可能。

3. Phi-4の導入を検討すべき企業のポイント

Phi-4を導入することで、以下のような経営課題の解決が期待できます。

✅ 業務コスト削減(自動化による労働コストの削減)

✅ データ活用の高度化(大量データの処理・分析の効率向上)

✅ 多言語対応の強化(グローバル展開におけるコミュニケーション支援)

✅ AIのローカル運用によるセキュリティ強化(クラウド依存を低減)

4. Phi-4が向いていない企業とは?

一方で、以下のような企業はPhi-4の導入に向いていない可能性があります。

❌ リアルタイム性が求められる業務(高頻度の処理が必要なシステム)

❌ 超大規模なデータ処理が必要(PB単位のデータ分析など)

❌ LLMの高度なチューニングが必要(カスタムモデルを一から構築したい場合)

➡ このような企業は、GPT-4やDeepSeek R1のような大規模モデルの活用が適している可能性がある。

まとめ

Phi-4は、軽量ながら高性能なLLMとして、さまざまな業界での活用が可能 です。特に、以下のような企業に最適です。

✅ コストを抑えてAIを導入したい企業(クラウド依存を減らし、運用コストを削減可能)

✅ 機密情報を扱う企業(ローカル環境で安全に運用可能)

✅ 文書処理やデータ解析が多い企業(長文解析やデータ分析に強み)

✅ 業務の自動化を推進する企業(カスタマーサポート、データ入力の効率化)

一方で、リアルタイム処理や超大規模データ分析が必要な企業は、GPT-4やDeepSeek R1などの大規模モデルの方が適している可能性がある。

次のセクションでは、Phi-4を導入する際の判断ポイントを総括し、本当に実用レベルなのかを検証 します。

7. まとめ:Phi-4は企業DXに最適なAIモデルなのか?

Phi-4は、小型ながら高性能なLLMとして、多くの企業のDX推進やAI導入の選択肢になり得るモデルです。本記事では、技術的特徴や性能評価、実際のビジネス活用事例をもとに、Phi-4の実用性を検証しました。

その結果、Phi-4は次のような強みを持つことが明らかになりました。

1. Phi-4の強み

✅ 小型ながら高性能

Phi-4(14B)は、Llama 3.2(70B)やDeepSeek R1(67B)と比較しても知識処理や数学推論、コーディング能力で高いスコアを記録。

✅ 長文処理能力が優秀

最大**128,000トークン(約25万〜30万文字)**の長文を扱えるため、法務・金融・医療などの大量文書を扱う業務に適している。

✅ マルチモーダル対応

テキストだけでなく、画像・音声・翻訳にも対応 し、幅広い業務に適用可能。

✅ ローカル環境で運用可能

クラウドを使用せず、オンプレミス環境での運用が可能なため、セキュリティを重視する企業に最適。

✅ コストパフォーマンスが高い

小型モデルでありながら大規模モデルに匹敵する性能を発揮し、運用コストを削減しながら高度なAI活用を実現できる。

2. Phi-4が適している企業の特徴

Phi-4は、以下のような企業に最適な選択肢となります。

🔹 AI導入コストを抑えたい企業(ローカル環境での運用が可能)

🔹 データセキュリティを重視する企業(機密情報をクラウドに出さずに処理できる)

🔹 長文処理や文書要約を多用する企業(契約書、レポート、医療データの解析など)

🔹 業務の自動化を推進する企業(問い合わせ対応、ドキュメント管理、コーディング支援など)

🔹 マルチモーダル対応を活用したい企業(テキスト・画像・音声の統合処理を行う業務)

結論:Phi-4は実用レベルのローカルLLMか?

結論として、Phi-4は「ローカル環境で高性能なLLMを活用したい企業」にとって実用レベルのAIである と言えます。

特に、コストパフォーマンス・長文処理能力・マルチモーダル対応 という3つのポイントにおいて、他のLLMと比較しても競争力があります。

一方で、大規模モデルが必要な業務やリアルタイム処理を求める企業には、より適した選択肢がある可能性 もあります。企業がPhi-4を導入するかどうかの判断は、業務の要件とAI活用の目的に応じて慎重に行うことが重要 です。