「AIを使えば効率が上がるのは分かっている。でも万が一でも社外秘の情報が漏れたら…」

2026年現在、多くのDX担当者がこのジレンマに頭を悩ませています。ChatGPTやGeminiといった強力なクラウド型AIは非常に便利ですが、企業が直面しているのは「利便性」と「機密保持」の厳しいトレードオフです。

かといって一律に「利用禁止」を命じるのは、競争力を自ら手放すことに他なりません。ではデータを死守しながらAIの恩恵を100%引き出すにはどうすればいいのか?その答えが、「自社専用環境でのLLM運用」です。

クラウド型AIの便利な利点と見過ごせないリスク

クラウド型AIは初期投資を抑えて最新の知能を即座に利用できる点が最大のメリットです。しかし実務の現場で深く使い込もうとすればするほど、以下のリスクが無視できなくなります。

1. 入力データの学習利用リスク

多くのサービスで学習オフ設定も可能ですが、規約のサイレント変更や誤操作による漏洩リスクを完全にゼロにすることは困難です。「デバッグのためにコードを貼り付けた際、誤って本番環境のパスワードや顧客の個人情報を含めて送信してしまった」といったヒューマンエラーは、どれだけ厳格な社内規定を設けていても、人間の手で操作する以上100%防ぐことは不可能です。

2. エンタープライズ版でも残る保持リスク

「学習には利用されない」エンタープライズ契約であっても、データが外部プラットフォーム(AWSやAzure、OpenAI社等のクラウド)に送信・保管される事実は変わりません。社外のサーバーに機密データが存在し続けること自体が、セキュリティ監査上の障壁や潜在的な攻撃対象となります。

3. プロンプトに含まれる知財(IP)の流出

質問内容そのものが企業の戦略や未発表の技術情報を含んでいる場合、それが一度でも自社管理外へ出ること自体がリスクとなります。

4. サービスプラットフォームへの過度な依存

知能の基盤を他者のサーバーに委ねることは、将来的な規約変更や価格高騰、サービス停止に対抗する手段を失うことを意味します。

機密保持はAI活用の大前提

データの匿名化やマスキング(黒塗り)によってリスクを軽減する手法もありますが、文脈(コンテキスト)が重要なLLMにおいて、過度な加工は回答の精度を著しく低下させてしまいます。

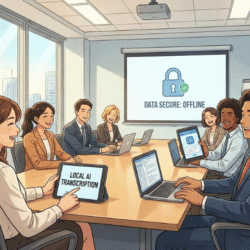

企業がAIを真に競争力の源泉とするためには、「データは1MBたりとも外部に出さない」という、妥協のないセキュリティ体制が必要です。これは単なる守りではなく、AIを制限なく使いこなすための「攻め」の入り口なのです。

選択肢としての自社専用LLM基盤(Microcosm)

こうした課題に対する現実的な解決策が、AIをクラウドから「借りる」のではなく、「自社専用の物理環境で構築する」という選択です。

弊社が提供するMicrocosm(マイクロコスム)は、完全閉鎖環境での運用を前提としたオンプレミスLLMパッケージです。

- 完全なデータ主権: インターネットから遮断された環境でも動作し、機密情報を社内ネットワーク内に留め置きます。

- 演算力と社内データの融合: DGX Sparkなどの強力なハードウェアと、最適化された最新LLMを組み合わせることで、社内の暗黙知(PDFや各種文書)を安全にAIに読み込ませることが可能です。

- 知能を資産として自社管理する: 自社に蓄積された資産を反映させたAIは、外部に真似のできない「独自の競争優位性」へと進化します。

データを資産に変える安全なAI導入へのステップ

これからのAI戦略において「誰でも使える汎用AI」を利用するフェーズは終わり、「自社データという独自の知能をいかに安全に実装し資産化するか」のフェーズが始まっています。

演算力、蓄積されたデータ、そしてそれらを繋ぐモデルを自社の管理下に置くことは、将来的なAIエージェントの自律化においても極めて重要な基盤となります。

最新AIの可能性を100%引き出すために安益なクラウド利用でリスクを背負うのではなく、「自社専用環境」という強固な防壁の内側から次のDXをスタートさせませんか?